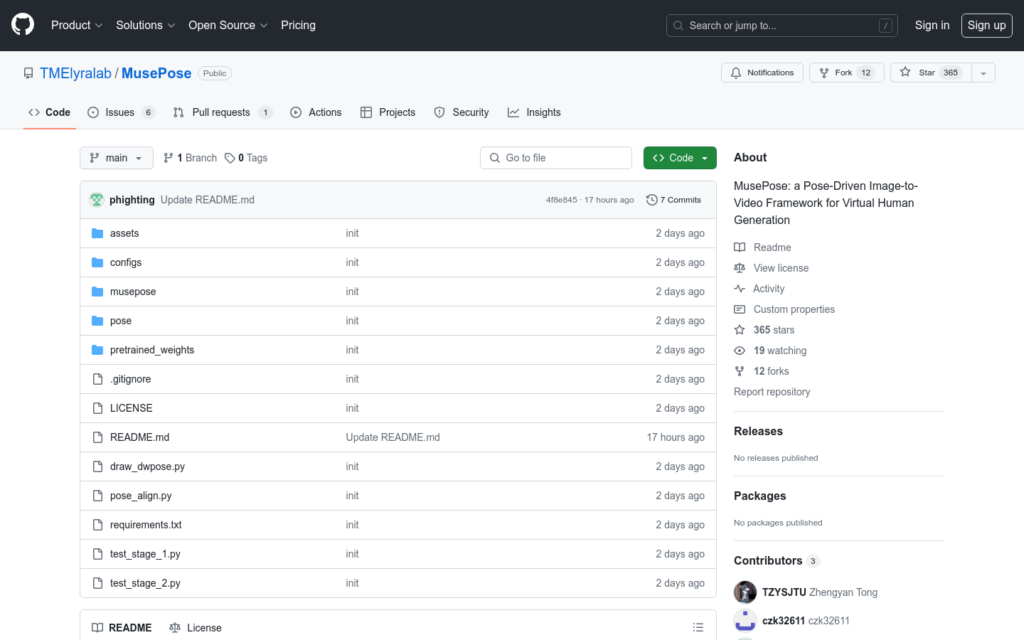

連結:https://github.com/TMElyralab/MusePose

MusePose是由騰訊音樂娛樂的Lyra Lab開發的一款影象到影片的生成框架,旨在透過姿勢控制訊號生成虛擬人物的影片。它是Muse開源系列的最後一個構建塊,與MuseV和MuseTalk一起,旨在推動社群向生成具有全身運動和互動能力的虛擬人物的願景邁進。MusePose基於擴散模型和姿勢引導,能夠生成參考影象中人物的舞蹈影片,並且結果質量超越了當前幾乎所有同一主題的開源模型。

需求人群:

MusePose主要面向希望生成虛擬人物影片內容的開發者和研究人員。無論是在遊戲開發、動畫製作還是虛擬實境領網網域,MusePose都能提供強大的技術支援,幫助使用者以較低的成本和較高的效率生成高質量的虛擬人物影片內容。

使用場景示例:

- 遊戲開發者使用MusePose生成遊戲角色的動態舞蹈影片。

- 動畫製作者利用MusePose快速製作動畫短片中的人物動作。

- 虛擬實境內容創作者使用MusePose為虛擬環境中的角色新增自然流暢的動作。

產品特色:

- 生成舞蹈影片:根據給定的姿勢序列生成參考影象中的人物舞蹈影片。

- 姿勢對齊演演算法:使用者可以對任意舞蹈影片和參考影象進行對齊,顯著提升推理效能和模型可用性。

- 改進的程式碼:基於Moore-AnimateAnyone的程式碼進行了重要的bug修復和改進。

- 詳細的教學:為新使用者提供了關於安裝和基本使用MusePose的詳細教學。

- 訓練指南:提供了訓練MusePose模型的指導。

- 人臉增強:如果需要,可以使用FaceFusion技術增強影片中的人臉區網網域,以獲得更好的面部一致性。