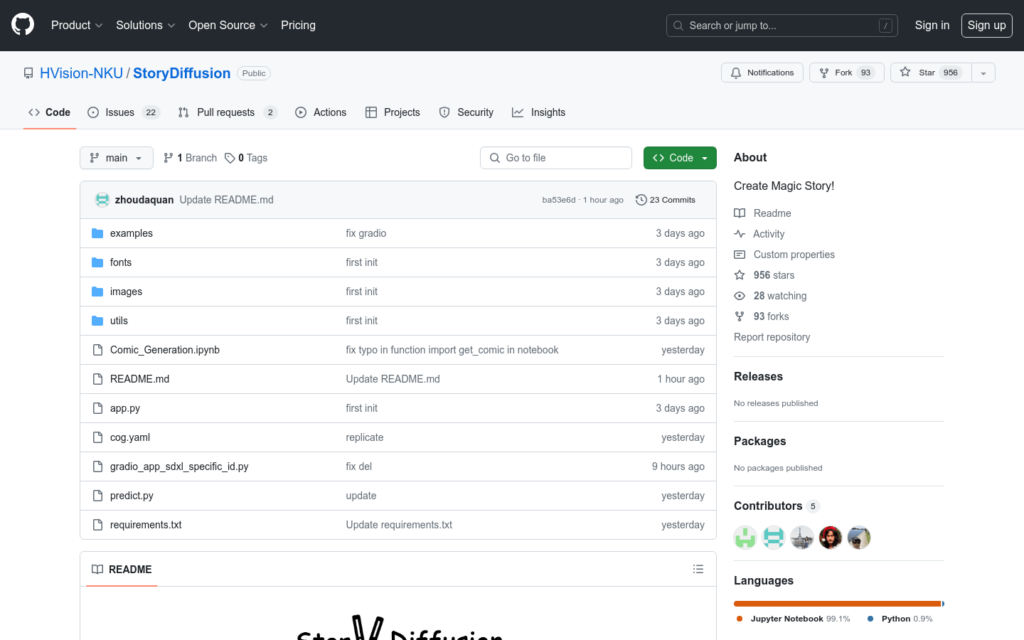

Link:https://github.com/HVision-NKU/StoryDiffusion

StoryDiffusion 是一個開源的影象和影片生成模型,它透過一致自注意力機制和運動預測器,能夠生成連貫的長序列影象和影片。這個模型的主要優點在於它能夠生成具有角色一致性的影象,並且可以擴充到影片生成,為使用者提供了一個創造長影片的新方法。該模型對AI驅動的影象和影片生成領網域有積極的影響,並且鼓勵使用者負責任地使用該工具。

需求人群:

[“設計師:可以利用StoryDiffusion快速生成設計概念圖。”,”影片製作者:可以用於生成影片內容的初步草圖。”,”研究人員:可以用於AI影象和影片生成領網域的研究。”,”愛好者:對於對AI藝術創作感興趣的個人,StoryDiffusion 提供了一個實驗和創造的平臺。”]

使用場景示例:

使用StoryDiffusion生成一系列漫畫風格的影象。

建立一個基於文本提示的長影片,展示一個連貫的故事。

利用StoryDiffusion進行角色設計和場景佈局的預視覺化。

產品特色:

一致自注意力機制:生成長序列中的角色一致影象。

運動預測器:在壓縮的影象語義空間中預測運動,實作更大的運動預測。

漫畫生成:利用一致自注意力機制生成的影象,無縫過渡建立影片。

影象到影片的生成:提供使用者輸入的條件影象序列來生成影片。

兩階段長影片生成:結合兩個部分生成非常長且高質量的AIGC影片。

條件影象使用:影象到影片模型可以透過提供一系列使用者輸入的條件影象來生成影片。

短影片生成:提供快速的影片生成結果。