連結:https://huggingface.co/bosonai/Higgs-Llama-3-70B

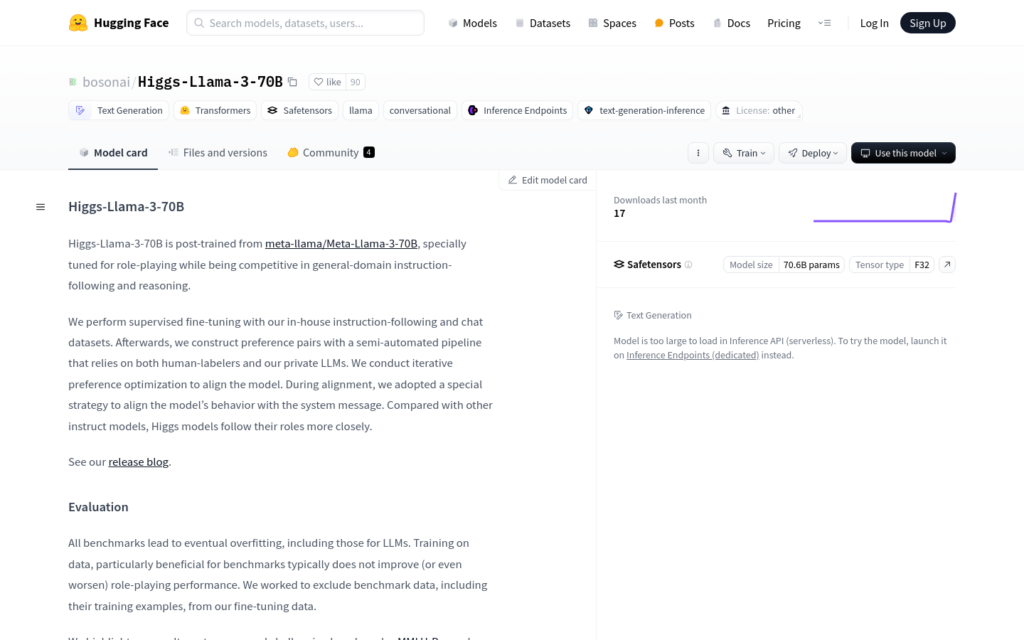

Higgs-Llama-3-70B是一個基於Meta-Llama-3-70B的後訓練模型,特別針對角色扮演進行了最佳化,同時在通用領網網域指令執行和推理方面保持競爭力。該模型透過監督式微調,結合人工標註者和私有大型語言模型構建偏好對,進行迭代偏好最佳化以對齊模型行為,使其更貼近系統訊息。與其它指令型模型相比,Higgs模型更緊密地遵循其角色。

需求人群:

目標受眾為需要在角色扮演或對話生成場景中使用語言模型的開發者和企業。該產品適合他們,因為它提供了專為角色扮演最佳化的模型,能夠提供更自然和連貫的對話體驗,同時保持在通用領網網域的指令執行和推理能力。

使用場景示例:

- 開發者可以利用該模型建立具有角色特色的聊天機器人。

- 企業可以在客戶服務中整合該模型,以提供更具個性化的服務體驗。

- 教育領網網域可以利用該模型模擬特定角色,以增強學習互動性。

產品特色:

- 角色扮演最佳化:專為角色扮演場景設計,提供更自然的互動體驗。

- 通用領網網域指令執行:在廣泛領網網域內能夠理解和執行使用者的指令。

- 推理能力:具備較強的邏輯推理能力,能夠處理複雜的查詢和問題。

- 迭代偏好最佳化:透過迭代最佳化,使模型行為更符合預期。

- 系統訊息對齊:模型行為與系統訊息高度一致,確保角色扮演的連貫性。

- 大型語言模型:擁有70.6B引數,提供強大的語言理解和生成能力。

- 多基準測試表現:在MMLU-Pro和Arena-Hard等基準測試中表現優異。

使用教學:

1. 匯入必要的庫:`import transformers` 和 `import torch`。

2. 設定模型ID為 `bosonai/Higgs-Llama-3-70B`。

3. 建立文本生成pipeline,指定模型ID和引數。

4. 準備對話訊息,包括系統角色和使用者角色的訊息內容。

5. 使用pipeline的tokenizer應用聊天範本,準備prompt。

6. 呼叫pipeline生成文本,設定最大新token數、結束token ID等引數。

7. 列印生成的文本,檢視模型輸出的結果。