Link:https://walt-video-diffusion.github.io

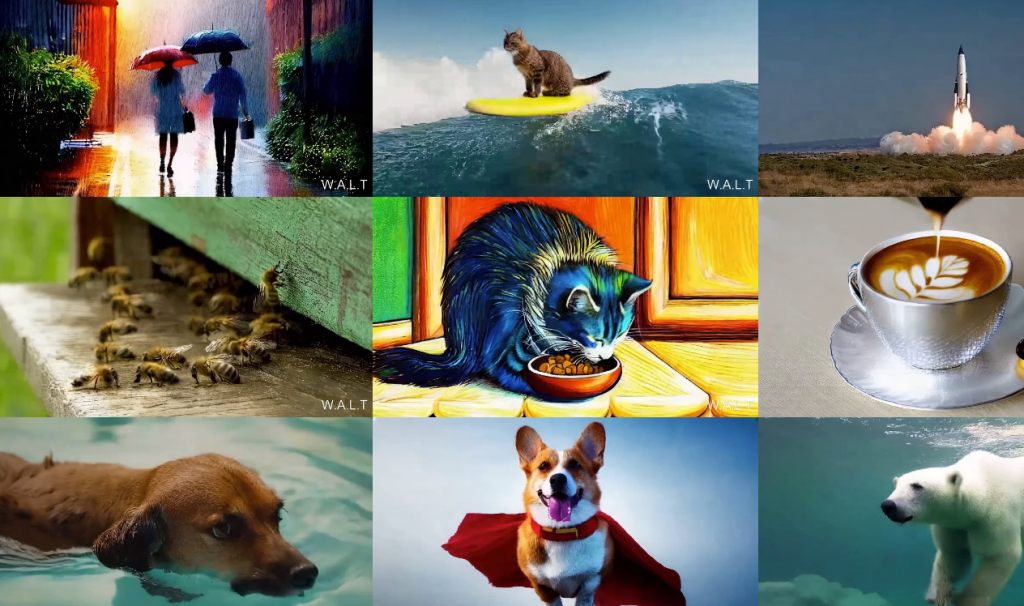

W.A.L.T是一種通過擴散建模生成真實感視頻的基於變換器的方法。 W.A.L.T有兩個關鍵的設計決策。 首先,使用因果編碼器在統一的潜在空間內聯合壓縮影像和視頻,實現跨模態的訓練和生成。 其次,為了提高記憶和訓練效率,使用了一種專門為聯合空間和時空生成建模量身定制的視窗注意力架構。 總之,這些設計決策能够在不使用無分類器指導的情况下,在已建立的視頻(UCF-101和Kinetics-600)和影像(ImageNet)生成基準上實現最先進的效能。 最後,還為文字到視頻生成任務訓練了三個模型的級聯,包括一個基本潜在視頻擴散模型和兩個視頻超分辯率擴散模型,以每秒8幀的速度生成512 x 896分辯率的視頻。

需求人群:

[“生成高保真影片”,”生成動畫”,”生成影片預覽”]

使用場景示例:

輸入文字描述,生成相應的實景影片

輸入影象,生成含有該影象內容的影片

輸入影片幾幀關鍵幀,生成完整細緻的高畫質影片

產品特色:

實景影片生成

影象生成

文字到影片生成