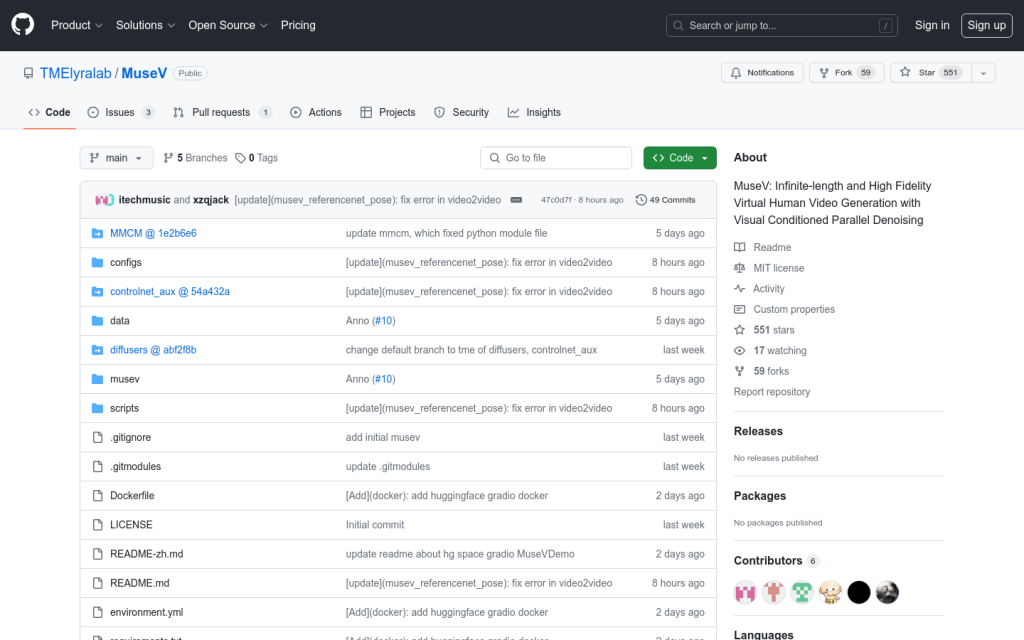

Link:https://github.com/TMElyralab/MuseV

MuseV是一個基於擴散模型的虛擬人影片生成框架,支援無限長度影片生成,採用了新穎的視覺條件並行去噪方案。它提供了預訓練的虛擬人影片生成模型,支援Image2Video、Text2Image2Video、Video2Video等功能,相容Stable Diffusion生態系統,包括基礎模型、LoRA、ControlNet等。它支援多參考影象技術,如IPAdapter、ReferenceOnly、ReferenceNet、IPAdapterFaceID等。MuseV的優勢在於可生成高保真無限長度影片,定位於影片生成領域。

需求人群:

“影片生成、虛擬人物創作、影視動畫製作、內容創作等場景”

使用場景示例:

- 使用MuseV生成一段演奏吉他的虛擬人物影片

- 根據文字描述和參考影象,使用MuseV創作一段動畫短片

- 將一段真實的人物影片轉換為虛擬人物風格的動畫影片

產品特色:

- 無限長度影片生成

- Text2Video、Image2Video、Video2Video

- 支援Stable Diffusion生態

- 支援多參考影象技術

- 高保真虛擬人影片生成