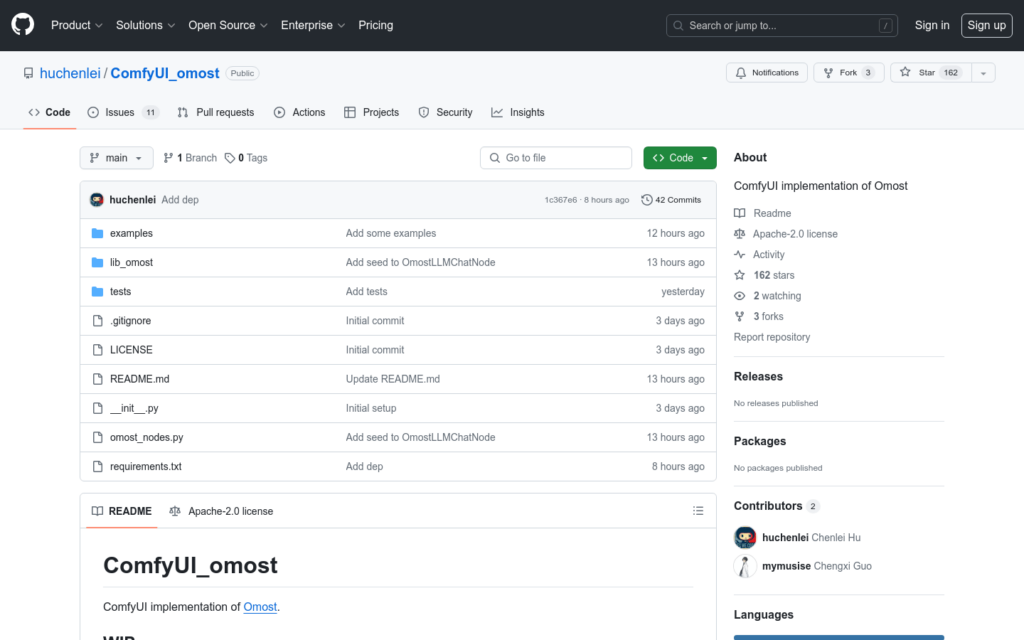

連結:https://github.com/huchenlei/ComfyUI_omost

ComfyUI_omost是一個基於ComfyUI框架實作的Omost模型,它允許使用者與大型語言模型(LLM)進行互動,以獲取類似JSON的結構化佈局提示。該模型目前處於開發階段,其節點結構可能會有變化。它透過LLM Chat和Region Condition兩個部分,將JSON條件轉換為ComfyUI的區網網域格式,用於影象生成和編輯。

需求人群:

目標受眾為影象生成和編輯領網網域的開發者和研究人員,他們可以利用ComfyUI_omost模型快速生成和編輯高質量的影象。此模型特別適合需要進行復雜影象佈局設計的使用者,因為它提供了結構化的JSON佈局提示,使得影象生成過程更加可控和精確。

使用場景示例:

- 使用LLM Chat進行簡單的影象生成。

- 透過多輪LLM Chat生成具有複雜佈局的影象。

- 結合ControlNet/IPAdapter對特定區網網域進行控制,生成具有特定特徵的影象。

產品特色:

- LLM Chat允許使用者與LLM進行互動,獲取JSON佈局提示。

- Region Condition部分將JSON條件轉換為ComfyUI的區網網域格式。

- 支援兩種重疊方法:覆蓋和平均。

- 可以與ControlNet/IPAdapter等其他控制方法組合使用。

- 提供了示例程式碼,展示如何進行簡單的LLM Chat和多輪LLM Chat。

- 計劃實作Omost的區網網域面積條件(DenseDiffusion)。

- 計劃新增聊天節點的進度條和區網網域條件編輯器。

使用教學:

步驟1: 訪問ComfyUI_omost的GitHub頁面。

步驟2: 閱讀README檔案,瞭解模型的基本結構和使用方法。

步驟3: 下載或克隆程式碼庫到本地環境。

步驟4: 根據示例程式碼設定LLM Chat和Region Condition。

步驟5: 執行程式碼,與LLM進行互動,獲取JSON佈局提示。

步驟6: 使用Region Condition將JSON轉換為ComfyUI區網網域格式。

步驟7: 根據需要,將模型與其他控制方法組合使用,生成特定影象。

步驟8: 根據反饋調整引數,最佳化影象生成結果。