連結:https://research.nvidia.com/labs/toronto-ai/l4gm/

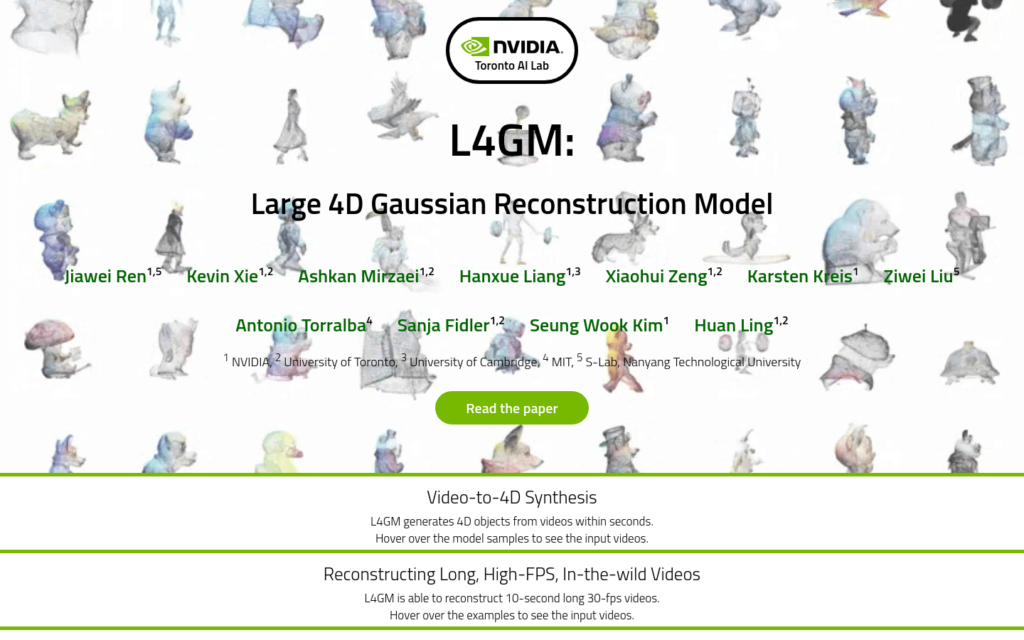

L4GM是一個4D大型重建模型,能夠從單視圖影片輸入中快速生成動畫對象。它採用了一種新穎的資料集,包含多視圖影片,這些影片展示了Objaverse中渲染的動畫對象。該資料集包含44K種不同的對象和110K個動畫,從48個視角渲染,生成了12M個影片,總共包含300M幀。L4GM基於預訓練的3D大型重建模型LGM構建,該模型能夠從多視圖影象輸入中輸出3D高斯橢球。L4GM輸出每幀的3D高斯Splatting表示,然後將其上取樣到更高的幀率以實作時間平滑。此外,L4GM還新增了時間自注意力層,以幫助學習時間上的一致性,並使用每個時間步的多視圖渲染損失來訓練模型。

需求人群:

- L4GM模型適合需要快速生成高質量動畫3D對象的專業人士和研究人員,如在電影製作、遊戲開發和虛擬實境等領網網域。它能夠顯著提高動畫製作效率,降低成本,併為創作者提供更大的創作自由度。

使用場景示例:

- 電影製作中快速生成動畫角色

- 遊戲開發中建立動態環境和角色

- 虛擬實境中構建互動式3D場景

產品特色:

- 從影片生成4D對象

- 支援長影片和高幀率影片的重建

- 透過4D插值模型提高幀率

- 使用U-Net架構和自注意力機制

- 支援自動重建和時間一致性

- 利用多視圖渲染損失進行模型訓練

使用教學:

1. 準備一段單視圖影片輸入

2. 使用L4GM模型進行4D重建

3. 觀察模型輸出的3D高斯Splatting表示

4. 利用插值模型提高影片幀率

5. 透過自注意力機制確保時間上的一致性

6. 利用多視圖渲染損失最佳化模型訓練

7. 將生成的動畫對象應用於所需的場景或專案中