Link:vividtalk

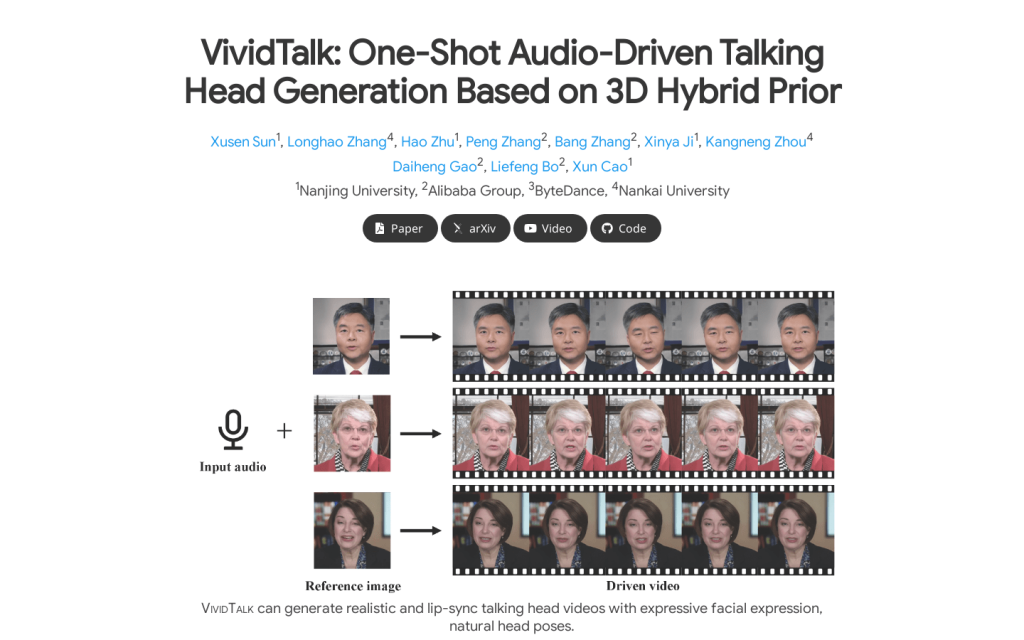

VividTalk是一種一次性音訊驅動的頭像生成技術,基於3D混合先驗。它能夠生成具有表情豐富、自然頭部姿態和唇同步的逼真說唱影片。該技術採用了兩階段通用框架,支援生成具有上述所有特性的高視覺質量的說唱影片。具體來說,在第一階段,透過學習兩種運動(非剛性表情運動和剛性頭部運動),將音訊對映到網格。對於表情運動,採用混合形狀和頂點作為中間表示,以最大化模型的表徵能力。對於自然頭部運動,提出了一種新穎的可學習頭部姿勢碼本,並採用兩階段訓練機制。在第二階段,提出了一個雙分支運動VAE和一個生成器,將網格轉換為密集運動,並逐幀合成高質量影片。大量實驗證明,VividTalk能夠生成具有唇同步和逼真增強的高視覺質量說唱影片,且在客觀和主觀比較中優於以往的最先進作品。該技術的程式碼將在發表後公開發布。

需求人群:

"VividTalk可用於建立逼真的說唱影片,支援不同風格的面部影象動畫,適用於多種語言的說唱影片製作。"

使用場景示例:

1. 使用VividTalk生成逼真的說唱影片,用於虛擬主持人的製作。

2. 利用VividTalk製作卡通風格的音訊驅動頭像生成影片。

3. 使用VividTalk進行多語言音訊驅動的頭像生成影片製作。

產品特色:

生成逼真、唇同步的說唱影片

支援不同風格的面部影象動畫,如人類、寫實和卡通

根據不同的音訊訊號建立說唱影片

比較VividTalk與最先進的方法在唇同步、頭部姿態自然性、身份保留和影片質量方面的差異