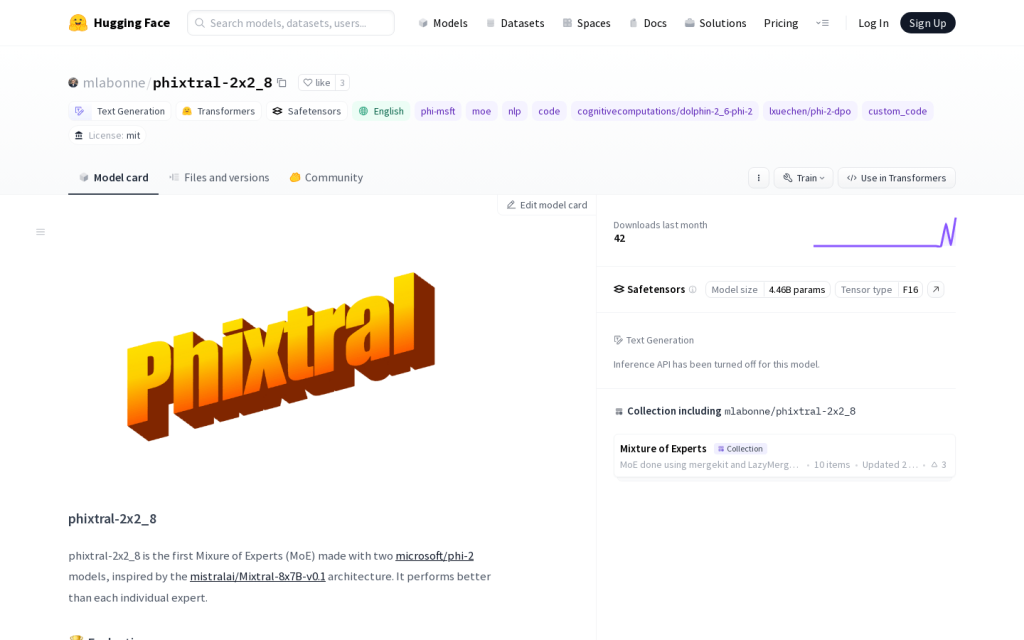

Link:phixtral-2×2-8

phixtral-2x2_8是第一個由兩個microsoft/phi-2模型製作的混合專家模型,受到mistralai/Mixtral-8x7B-v0.1架構的啟發。其效能優於每個單獨的專家模型。該模型在AGIEval、GPT4All、TruthfulQA、Bigbench等多個評估指標上表現優異。它採用了自定義版本的mergekit庫(mixtral分支)和特定配置。使用者可以在Colab notebook上以4位精度在免費的T4 GPU上執行Phixtral。模型大小為4.46B引數,張量型別為F16。

需求人群:

"可用於文字生成、模型評估、深度學習研究等領域"

使用場景示例:

在深度學習研究中使用phixtral-2x2_8模型進行文字生成

利用phixtral-2x2_8模型進行模型評估

在GPU上以4位精度執行phixtral-2x2_8模型

產品特色:

使用混合專家模型進行文字生成

在Colab notebook上以4位精度在GPU上執行模型

模型大小為4.46B引數,張量型別為F16