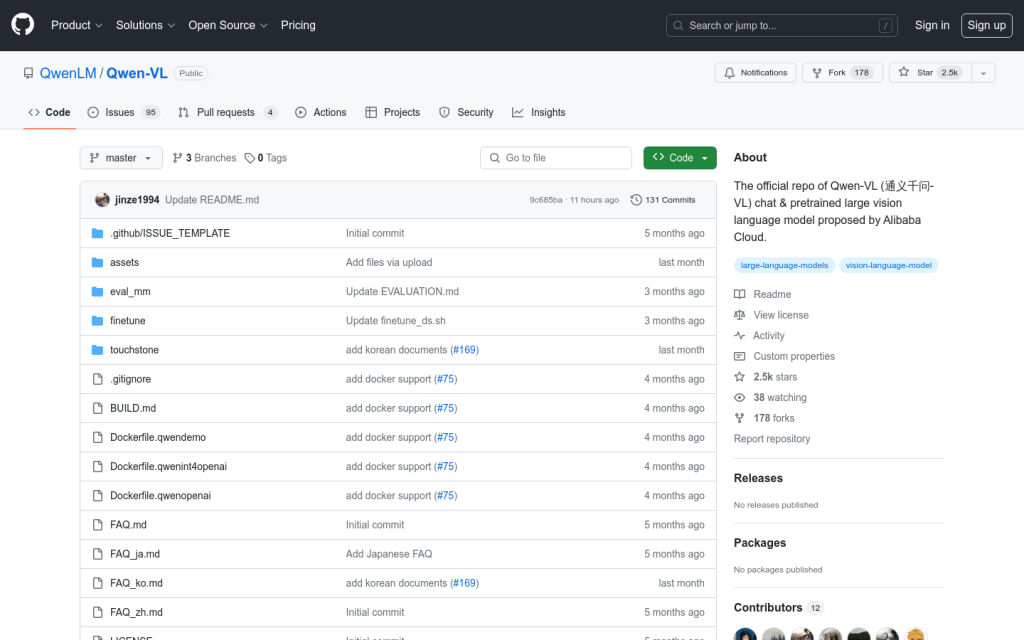

Link:qwen-vl

Qwen-VL 是阿里雲推出的通用型視覺語言模型,具有強大的視覺理解和多模態推理能力。它支援零樣本影象描述、視覺問答、文字理解、影象地標定位等任務,在多個視覺基準測試中達到或超過當前最優水平。該模型採用 Transformer 結構,以 7B 引數規模進行預訓練,支援 448×448 解析度,可以端到端處理影象與文字的多模態輸入與輸出。Qwen-VL 的優勢包括通用性強、支援多語種、細粒度理解等。它可以廣泛應用於影象理解、視覺問答、影象標註、圖文生成等任務。

需求人群:

["影象理解","視覺問答","影象標註","圖文生成"]

使用場景示例:

將圖片描述成文字

回答關於圖片的問題

理解圖片中的文字資訊

產品特色:

零樣本影象描述

視覺問答

文字理解

影象地標定位

多語言支援

細粒度影象理解