連結:https://signllm.github.io/

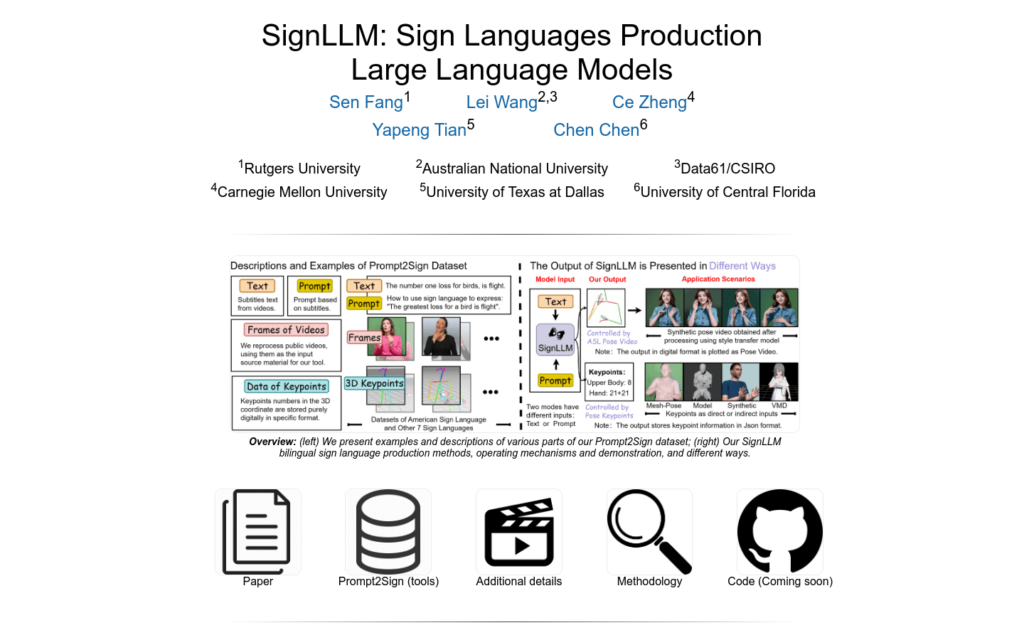

SignLLM是首個多語種手語生成模型,它基於公共手語資料構建,包括美國手語(ASL)和其他七種手語。該模型能夠從文本或提示生成手語手勢,並透過強化學習加速訓練過程,提高資料取樣質量。SignLLM在八種手語的生產任務上都達到了最先進的效能。

需求人群:

SignLLM主要面向手語翻譯、手語教學和聾人社群。它透過提供高質量的手語生成模型,幫助聾人更好地理解和學習手語,同時也為手語翻譯和教學提供技術支援。

使用場景示例:

- 聾人社群使用SignLLM學習手語,提高溝通能力

- 手語翻譯人員利用SignLLM進行實時翻譯,提高工作效率

- 教育機構將SignLLM作為輔助教學工具,幫助學生學習手語

產品特色:

- 多語種手語資料集Prompt2Sign的構建與最佳化

- 基於seq2seq和text2text模型的翻譯模型訓練

- 兩種新穎的多語種手語生成模式

- 基於強化學習的新型損失函式和模組

- 透過風格遷移/特定微調生成模型將輸出轉換為真實人類外觀

- 與現有模型相比,在手語生成任務上取得顯著效能提升

使用教學:

步驟1: 訪問SignLLM官網並下載相關資料集和程式碼

步驟2: 根據官方文檔將手語影片轉換為模型友好的格式

步驟3: 使用SignLLM提供的多語種手語生成模式進行訓練

步驟4: 利用強化學習模組最佳化模型訓練過程

步驟5: 將模型輸出透過風格遷移/特定微調生成模型轉換為真實手語影片

步驟6: 根據需要調整模型引數,最佳化手語生成效果