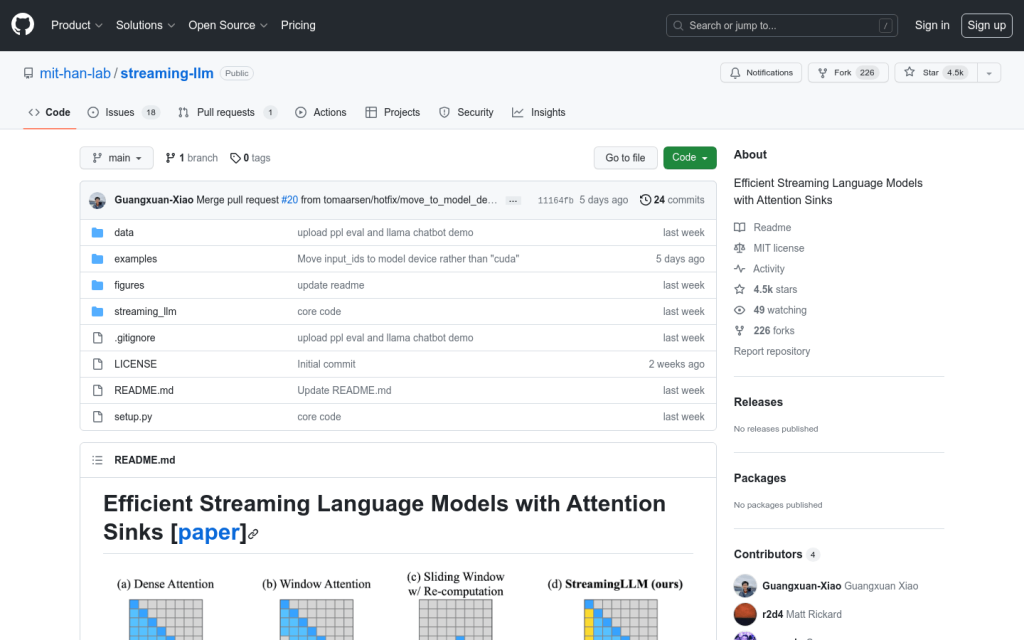

Link:streamingllm

StreamingLLM是一種高效的語言模型,能夠處理無限長度的輸入,而不會犧牲效率和效能。它透過保留最近的令牌和注意力池,丟棄中間令牌,從而使模型能夠從最近的令牌生成連貫的文字,而無需快取重置。StreamingLLM的優勢在於能夠在不需要重新整理快取的情況下,從最近的對話中生成響應,而不需要依賴過去的資料。

需求人群:

"StreamingLLM適用於需要連續操作而不需要大量記憶體或依賴於過去資料的場景,例如基於LLMs的日常助手。"

使用場景示例:

使用StreamingLLM進行多輪對話

使用StreamingLLM進行文字生成

使用StreamingLLM進行文字分類

產品特色:

處理無限長度的輸入

保留最近的令牌和注意力池,丟棄中間令牌

從最近的令牌生成連貫的文字

不需要快取重置

適用於流式應用,如多輪對話