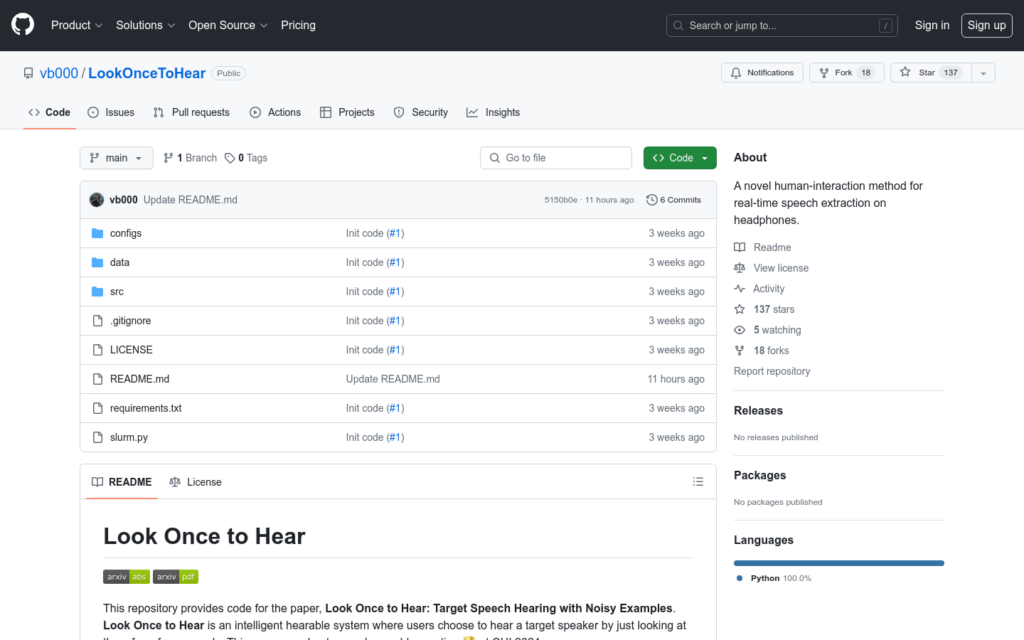

連結:https://github.com/vb000/LookOnceToHear

LookOnceToHear 是一種創新的智慧耳機互動系統,允許使用者透過簡單的視覺辨識來選擇想要聽到的目標說話者。這項技術在 CHI 2024 上獲得了最佳論文榮譽提名。它透過合成音訊混合、頭相關傳輸函式(HRTFs)和雙耳房間脈衝響應(BRIRs)來實作實時語音提取,為使用者提供了一種新穎的互動方式。

需求人群:

- 該產品適合需要在嘈雜環境中進行語音辨識和提取的研究人員和開發者。例如,它可以幫助聽力障礙者在嘈雜環境中更好地理解對話,或者在多聲源環境中進行語音分析和處理。

使用場景示例:

- 在會議中,透過 LookOnceToHear 選擇聽取特定發言人的聲音

- 在嘈雜的公共場所,幫助聽力障礙者集中聽取對話

- 在音訊分析研究中,用於區分和提取多個聲源

產品特色:

- 使用者透過看向目標說話者幾秒鐘來選擇想要聽到的聲音

- 使用 Scaper 工具包合成生成音訊混合

- 提供自包含的資料集和訓練用的 .jams 規範檔案

- 支援實時語音提取和目標語音聽力模型的評估

- 提供了模型的檢查點,方便使用者進行訓練和評估

- 適用於嘈雜環境下的語音辨識和提取

使用教學:

下載並解壓提供的 .zip 檔案到 data/ 目錄

執行命令以開始訓練過程

使用 Scaper 的 generate_from_jams 函式在 .jams 規範檔案上生成音訊混合

下載並載入目標語音聽力模型的檢查點進行評估

根據需要調整模型引數以最佳化效能

在實際應用中,使用者只需看向目標說話者即可開始語音提取