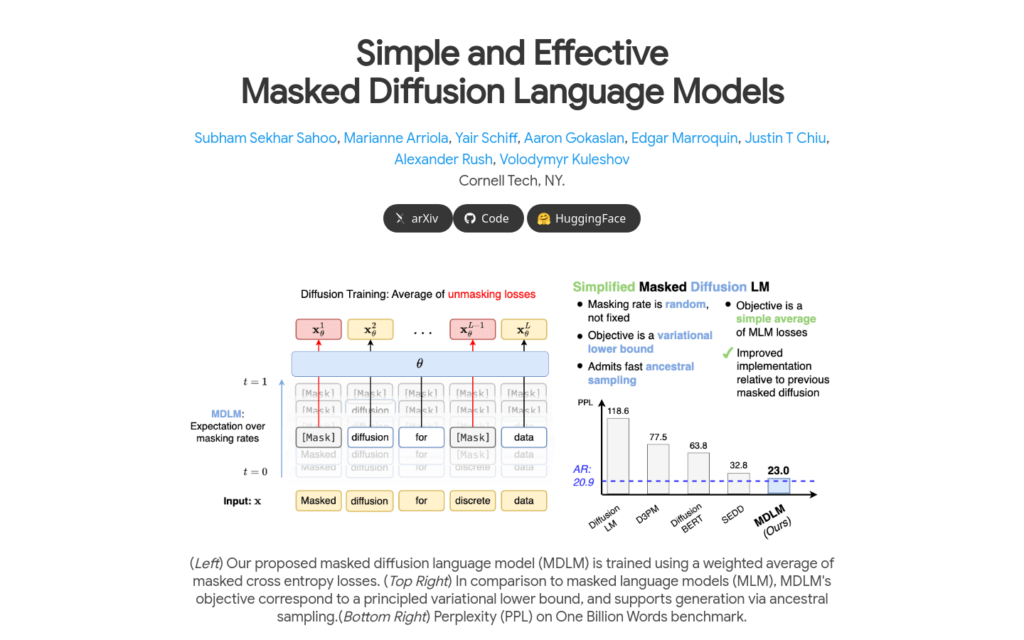

Masked Diffusion Language Models (MDLM) 是一種新型的語言模型,它透過遮蔽和擴散機制來生成高質量的文本資料。MDLM 透過改進的訓練方法和簡化的目標函式,提高了遮蔽擴散模型的效能,使其在語言建模基準測試中達到了新的最佳狀態,並接近自迴歸模型的困惑度。MDLM 的主要優點包括高效的取樣器、支援生成任意長度的文本,以及在長程依賴和可控生成方面的優勢。

需求人群:

- MDLM 適合需要生成高質量文本資料的研究人員和開發者,特別是在長文本生成、可控文本生成和快速取樣方面有需求的場景。例如,自然語言處理領網網域的研究人員可以使用 MDLM 來改進他們的語言模型,提高文本生成的質量和效率。

使用場景示例:

- 研究人員使用 MDLM 進行長文本的自動摘要生成。

- 開發者利用 MDLM 在聊天機器人中生成更加自然和流暢的對話。

- 教育機構採用 MDLM 生成教學材料和課程內容。

產品特色:

- 使用加權平均遮蔽交叉熵損失進行訓練。

- 與自迴歸方法相比,MDLM 的目標對應於一個原理性的變分下界。

- 支援透過祖先取樣進行文本生成。

- 在 One Billion Words 基準測試中表現出較低的困惑度。

- 透過現代工程實踐訓練的 MDLM 在語言建模中達到了新的最佳狀態。

- MDLM 可以訓練編碼器僅語言模型,允許高效的取樣器。

使用教學:

第一步:瞭解 MDLM 的基本原理和功能。

第二步:獲取 MDLM 模型和相關的訓練程式碼。

第三步:準備訓練資料集,包括遮蔽和未遮蔽的文本樣本。

第四步:使用 MDLM 進行模型訓練,調整引數以最佳化效能。

第五步:在特定任務上測試 MDLM,評估生成文本的質量。

第六步:將訓練好的 MDLM 模型整合到實際應用中。