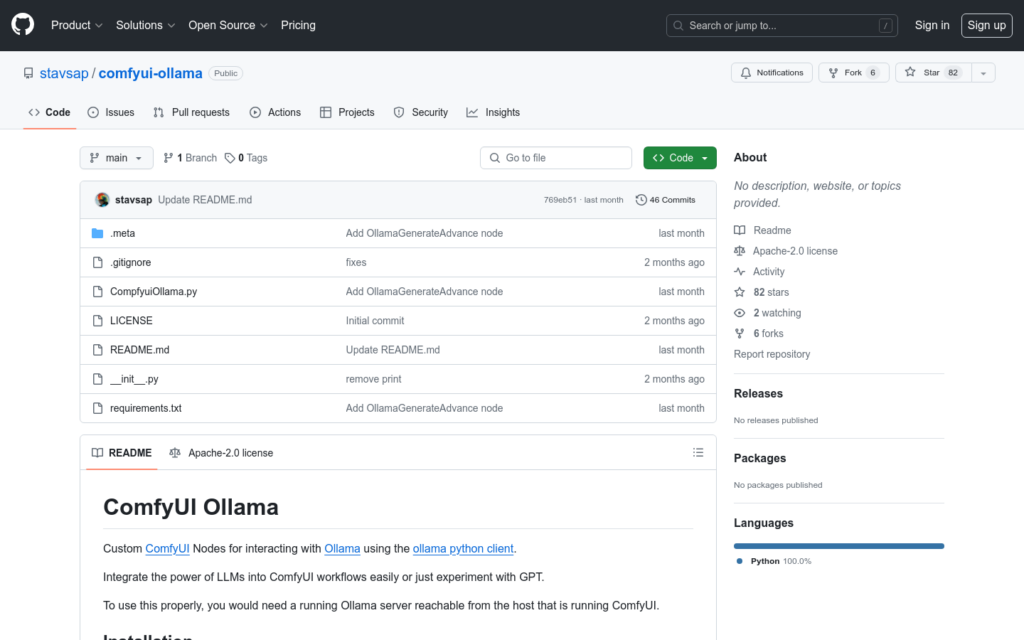

Link:comfyui-ollama

ComfyUI Ollama是為ComfyUI工作流設計的自訂節點,它使用ollama Python用戶端,允許使用者輕鬆地將大型語言模型(LLM)整合到他們的工作流程中,或者僅僅是進行GPT實驗。這個外掛的主要優點在於它提供了與Ollama伺服器互動的能力,使得使用者可以執行影象查詢、透過給定的提示查詢LLM,以及使用精細調整引數進行LLM查詢,同時保持生成鏈的上下文。

需求人群:

[“開發者:可以利用ComfyUI Ollama外掛快速整合LLM到他們的開發專案中。”,”研究人員:可以使用該外掛進行語言模型的實驗和研究。”,”資料科學家:可以利用影象查詢和文本處理功能來增強他們的資料分析工作。”]

使用場景示例:

使用OllamaVision節點對輸入影象進行視覺分析。

透過OllamaGenerate節點根據特定提示生成文本。

結合OllamaGenerateAdvance節點進行更復雜的文本生成任務,如保持上下文的生成鏈。

產品特色:

OllamaVision:提供查詢輸入影象的能力。

OllamaGenerate:透過給定的提示查詢LLM。

OllamaGenerateAdvance:透過給定的提示查詢LLM,並允許微調引數和保持生成鏈的上下文。

與Ollama伺服器的整合:需要一個可從執行ComfyUI的主機訪問的執行中的Ollama伺服器。

自訂節點安裝:支援透過Git URL安裝或直接克隆到custom_nodes資料夾。

引數詳細資訊:提供對Ollama API文檔中引數的訪問,以獲取更多資訊。

使用示例:提供瞭如何將影象視覺與LLM文本處理結合使用的示例。