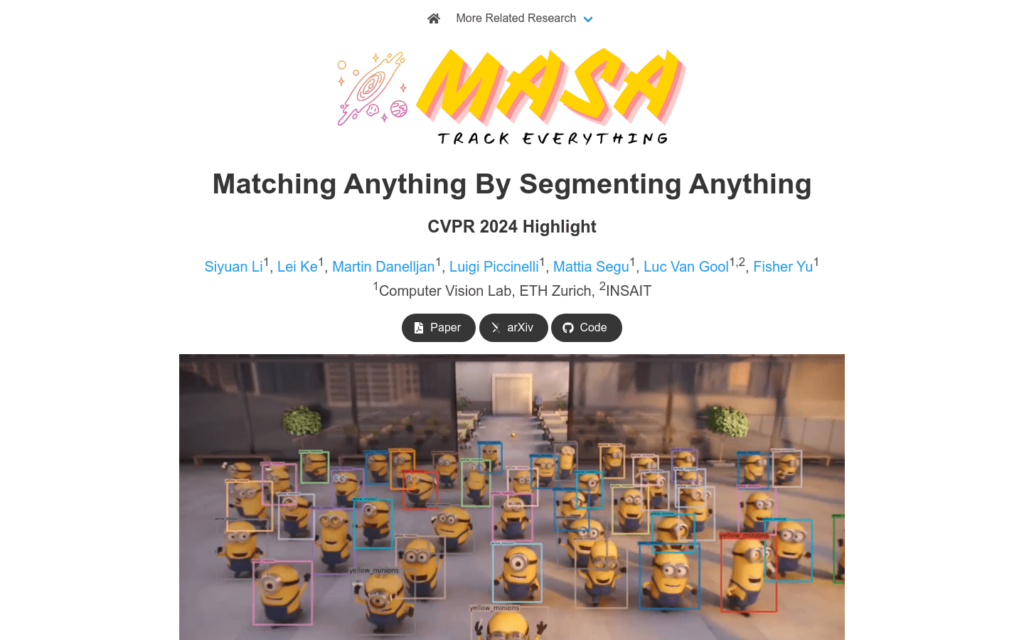

連結:https://matchinganything.github.io/

MASA是一個用於影片幀中對象匹配的先進模型,它能夠處理複雜場景中的多目標跟蹤(MOT)。MASA不依賴於特定領網網域的標註影片資料集,而是透過Segment Anything Model(SAM)豐富的對象分割,學習實例級別的對應關係。MASA設計了一個通用適配器,可以與基礎的分割或偵測模型配合使用,實作零樣本跟蹤能力,即使在複雜領網網域中也能表現出色。

需求人群:

- MASA模型適合於電腦視覺領網網域的研究人員和開發者,特別是那些需要在影片分析中實作高效、準確目標跟蹤的專業人士。

使用場景示例:

- 在交通監控系統中,MASA可以用於追蹤和分析車輛的移動。

- 在體育賽事分析中,MASA能夠跟蹤運動員的動態,為戰術分析提供資料支援。

- 在野生動物研究中,MASA可以用於追蹤動物的行為模式,幫助科學家進行研究。

產品特色:

- MASA能夠匹配影片內任何領網網域中的任何對象。

- 使用Segment Anything Model(SAM)進行豐富的對象分割。

- MASA適配器可以與基礎分割或偵測模型配合使用。

- 實作零樣本跟蹤能力,無需跟蹤標籤。

- 在多目標跟蹤(MOT)和多目標跟蹤與分割(MOTS)基準測試中表現出色。

- 使用未標註的靜態影象,實作比訓練有素的領網網域內影片序列更好的效能。

使用教學:

1. 訪問MASA的官方網站以獲取模型和相關文檔。

2. 閱讀並理解MASA的工作原理和使用條件。

3. 下載並安裝必要的軟體和庫,以支援MASA模型的執行。

4. 準備或獲取影片資料,確保資料質量滿足MASA的要求。

5. 根據文檔指導,配置MASA模型的引數和輸入輸出。

6. 執行MASA模型,對影片資料進行目標跟蹤和分析。

7. 分析MASA模型的輸出結果,根據需要進行進一步的處理或視覺化。