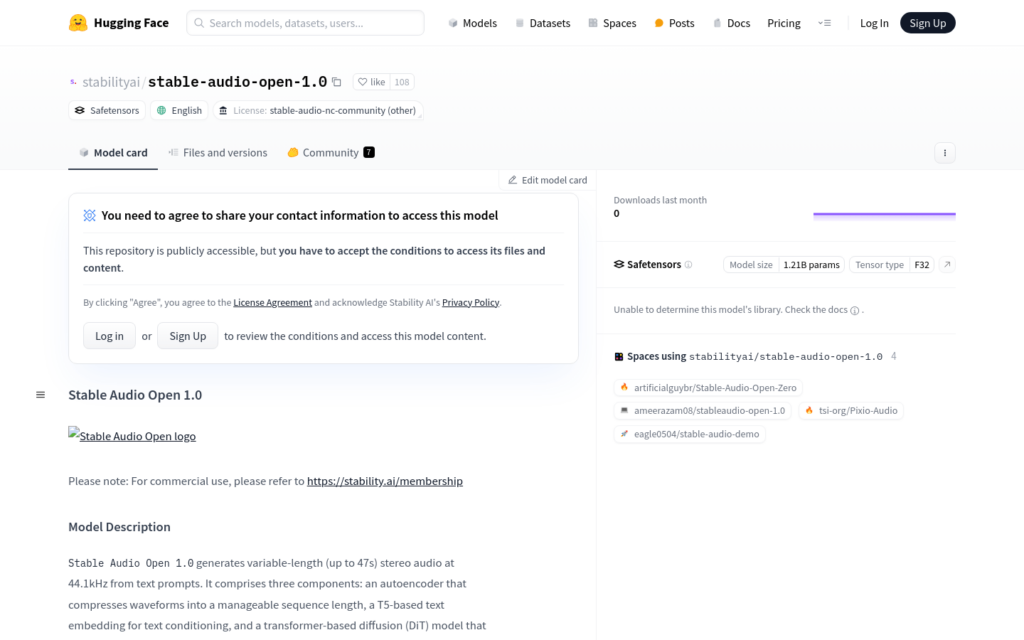

連結:https://huggingface.co/stabilityai/stable-audio-open-1.0

Stable Audio Open 1.0是一個利用自編碼器、基於T5的文本嵌入和基於變壓器的擴散模型來生成長達47秒的立體聲音訊的AI模型。它透過文本提示生成音樂和音訊,支援研究和實驗,以探索生成性AI模型的當前能力。該模型在Freesound和Free Music Archive (FMA)的資料集上進行訓練,確保了資料的多樣性和版權合法性。

需求人群:

- 該產品適合音樂製作人、音訊工程師、研究人員以及任何對AI音樂生成感興趣的個人或團隊。它為藝術家提供了一個實驗和創造新音樂作品的工具,同時為研究人員提供了探索和改進生成性AI模型的平臺。

使用場景示例:

- 音樂製作人使用該模型根據文本提示生成新的背景音樂。

- 研究人員利用模型來分析和改進生成性AI模型的科學狀態。

- 音訊工程師使用該模型來探索不同文本提示下的聲音效果生成。

產品特色:

- 生成長達47秒的立體聲音訊。

- 支援44.1kHz的音訊取樣率。

- 基於文本提示的音樂和音訊生成。

- 使用自編碼器壓縮波形到可管理的序列長度。

- 基於T5的文本嵌入技術進行文本條件處理。

- 擴散模型在自編碼器的潛在空間中操作。

使用教學:

下載並安裝所需的stable-audio-tools庫。

使用提供的程式碼示例下載預訓練模型。

設定文本和時間條件,定義音訊的起始時間和總長度。

呼叫模型生成擴散條件音訊。

對生成的音訊進行重排、峰值歸一化、剪輯、轉換為int16格式,並儲存為檔案。