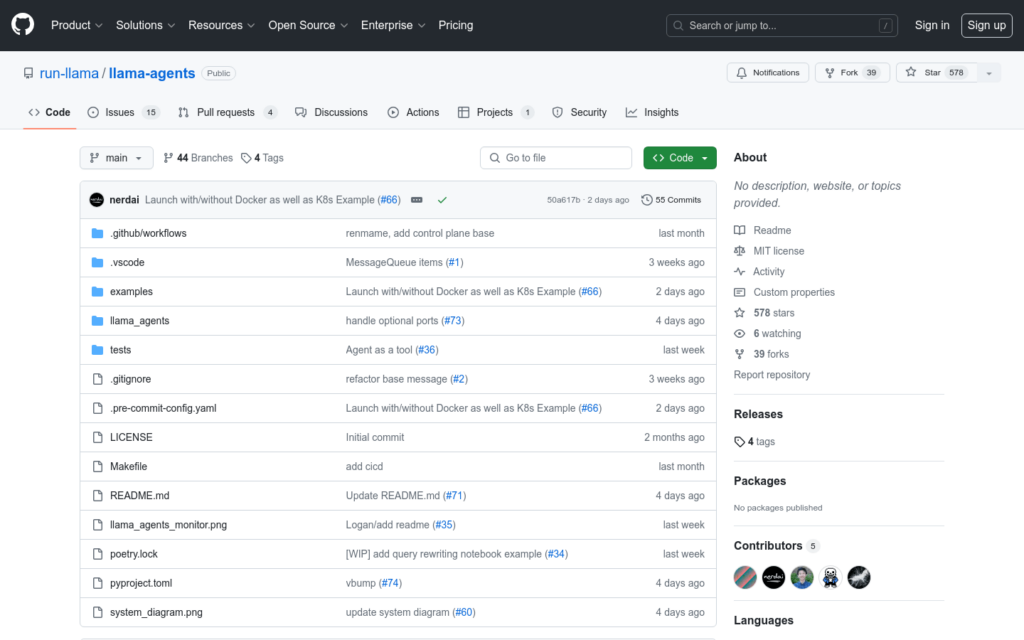

連結:https://github.com/run-llama/llama-agents

llama-agents 是一個非同步優先的框架,用於構建、迭代和生產化多智慧體系統,包括多智慧體通訊、分散式工具執行、人工在環等。每個智慧體被視為一個服務,不斷處理傳入的任務。智慧體從訊息佇列中拉取和釋出訊息。系統頂部是控制平面,它跟蹤正在進行的任務,網路中的服務,並決定哪個服務應該處理任務的下一步。

需求人群:

- 目標受眾為軟體開發者和系統架構師,特別是那些需要構建複雜多智慧體系統,或希望提高系統自動化和智慧化水平的專業人士。

使用場景示例:

- 構建一個包含多個智慧體協同工作的客服系統,提高響應速度和服務質量。

- 開發一個分散式的資料分析平臺,智慧體可以並行處理資料,提升分析效率。

- 實作一個人工在環的自動化測試系統,智慧體自動執行測試並由人工進行結果稽核。

產品特色:

- 支援多智慧體通訊和分散式工具執行

- 包含人工在環功能,實作更智慧的任務處理

- 頂層控制平面跟蹤任務和服務狀態,智慧決策任務處理流程

- 非同步設計,提高系統處理能力和響應速度

- 支援Docker和Kubernetes部署,易於擴充和整合

- 提供豐富的API和CLI工具,便於開發者監控和互動

使用教學:

1. 安裝llama-agents,使用pip安裝並依賴llama-index-core。

2. 設定智慧體和初始元件,建立AgentService和ControlPlaneServer等。

3. 編寫智慧體邏輯,定義智慧體如何響應和處理訊息佇列中的任務。

4. 啟動訊息佇列和控制平面,確保系統元件正常執行。

5. 註冊智慧體服務到訊息佇列和控制平面,使它們能夠接收和傳送訊息。

6. 使用LocalLauncher或ServerLauncher啟動智慧體系統,進行單次或伺服器模式的執行。

7. 透過使用者端或CLI工具與智慧體系統互動,建立任務並獲取結果。