Link:llava-

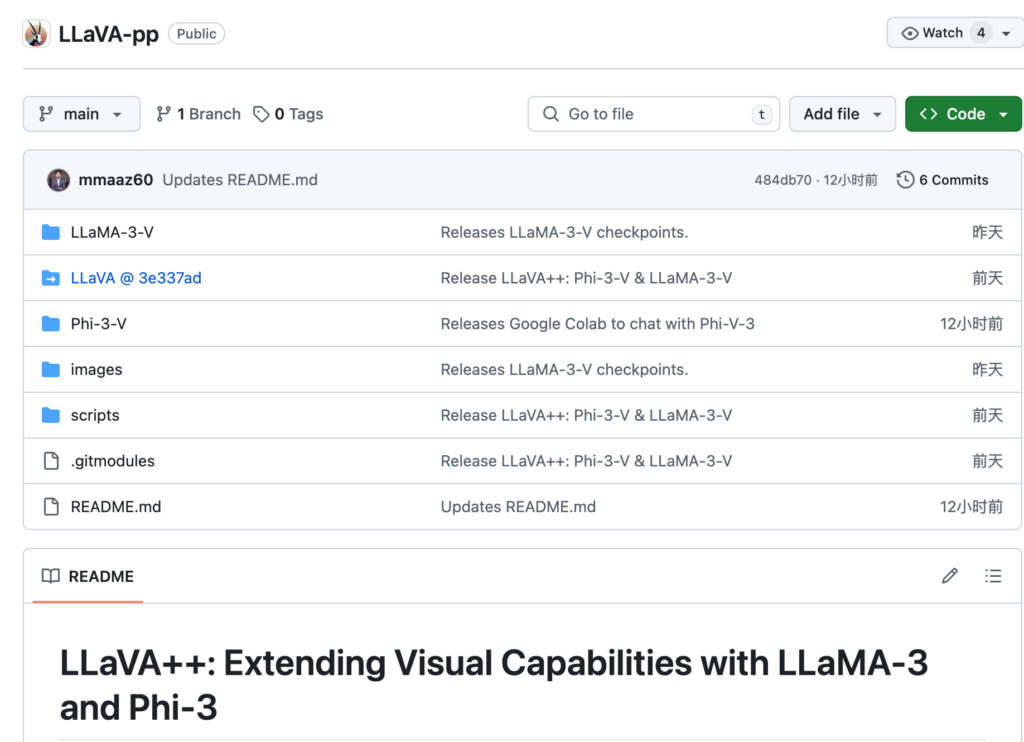

LLaVA++是一個開源專案,旨在透過整合Phi-3和LLaMA-3模型來擴充LLaVA模型的視覺能力。該專案由Mohamed bin Zayed University of AI (MBZUAI)的研究人員開發,透過結合最新的大型語言模型,增強了模型在遵循指令和學術任務導向資料集上的表現。

需求人群:

["研究人員和開發者可以利用LLaVA++進行語言模型的研究和開發。","適合需要進行語言理解和生成任務的商業應用。","教育領網域可以利用該模型進行語言教學和研究。","對於探索人工智慧在視覺和語言結合領網域的應用具有重要意義。"]

使用場景示例:

在教育領網域,LLaVA++可以用來輔助語言學習,提供準確的語言理解和生成。

商業應用中,可以整合LLaVA++來提升客服系統的智慧化水平。

研究機構可以利用LLaVA++進行語言模型的學術研究和發表相關論文。

產品特色:

整合Phi-3 Mini Instruct和LLaMA-3 Instruct模型,提升語言理解能力。

在多個基準測試和資料集上進行了效能比較,展示了模型的優勢。

提供了預訓練模型和LoRA權重微調模型,以適應不同的使用場景。

透過Google Colab提供互動式聊天體驗。

支援模型的預訓練和微調,以最佳化特定任務的效能。

提供了詳細的安裝和訓練指令,方便研究人員和開發者使用。