連結:https://badtobest.github.io/echomimic.html

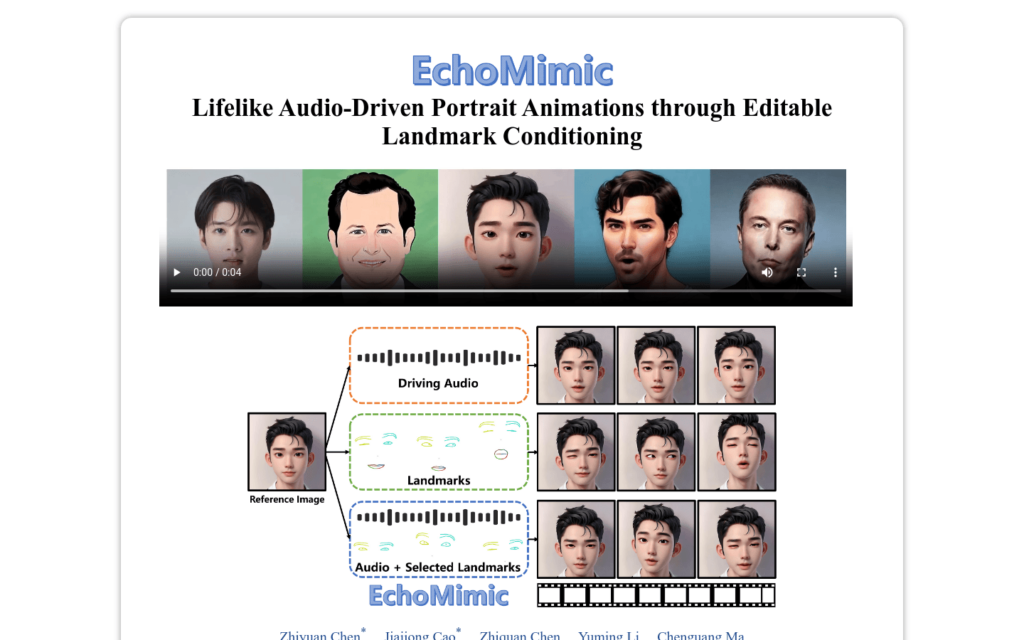

EchoMimic是一個先進的人像影象動畫模型,能夠透過音訊和選定的面部特徵點單獨或組合驅動生成逼真的肖像影片。它透過新穎的訓練策略,解決了傳統方法在音訊驅動時可能的不穩定性以及面部關鍵點驅動可能導致的不自然結果。EchoMimic在多個公共資料集和自收集資料集上進行了全面比較,並在定量和定性評估中展現出了卓越的效能。

需求人群:

- EchoMimic適用於需要生成逼真人像動畫的專業人士和愛好者,如影片製作者、動畫師、遊戲開發者等。它提供了一種創新的方法來增強視覺效果,提高內容的吸引力和互動性。

使用場景示例:

- 影片製作中使用EchoMimic生成主角的逼真面部表情

- 遊戲開發中利用EchoMimic為角色新增動態表情和口型同步

- 線上教育平臺使用EchoMimic為虛擬教師生成生動的面部動作

產品特色:

- 音訊驅動:根據音訊訊號生成動態人像動畫

- 面部特徵點驅動:利用面部關鍵點資訊生成動畫效果

- 音訊與面部特徵點結合:綜合音訊和麵部特徵點生成更逼真的動畫

- 多語言支援:包括中文和英文在內的多種語言音訊輸入

- 視覺化效果:提供視覺化的動畫效果展示

- 原始碼訪問:允許使用者訪問和學習模型的原始碼

使用教學:

1. 訪問EchoMimic專案頁面

2. 選擇音訊驅動或面部特徵點驅動模式

3. 上傳音訊檔案或標記面部關鍵點

4. 根據需要選擇音訊和麵部特徵點的組合方式

5. 啟動動畫生成過程

6. 調整生成的動畫效果,直至滿意

7. 下載或直接使用生成的動畫