Link:ella

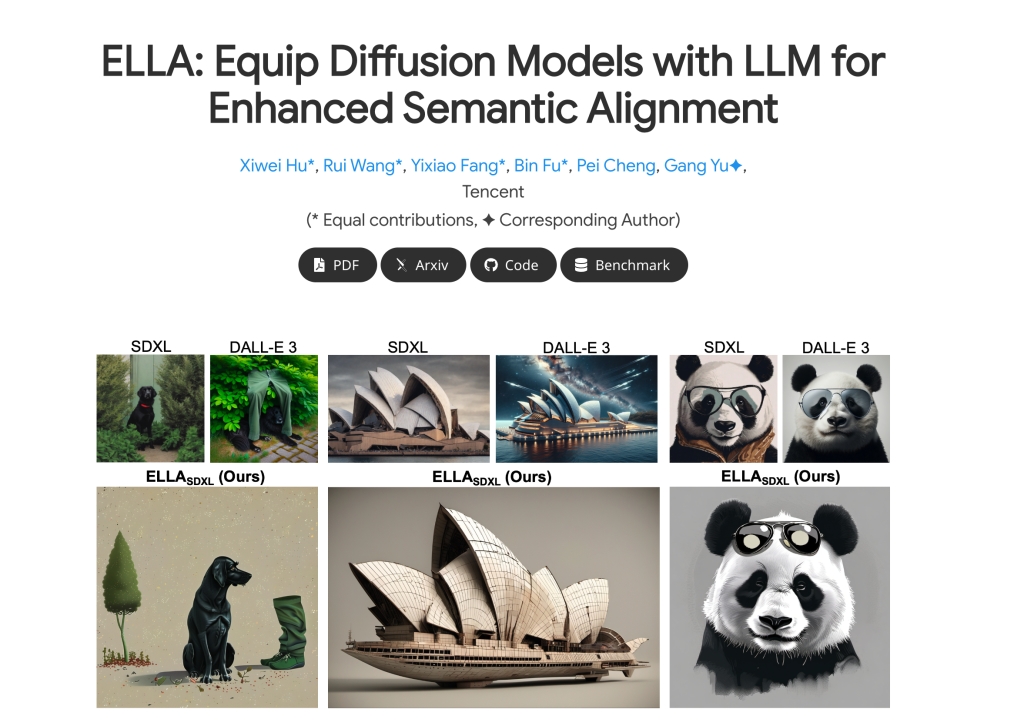

ELLA(Efficient Large Language Model Adapter)是一種輕量級方法,可將現有的基於CLIP的擴散模型配備強大的LLM。ELLA提高了模型的提示跟隨能力,使文字到影象模型能夠理解長文字。我們設計了一個時間感知語義連線器,從預訓練的LLM中提取各種去噪階段的時間步驟相關條件。我們的TSC動態地適應了不同取樣時間步的語義特徵,有助於在不同的語義層次上對U-Net進行凍結。ELLA在DPG-Bench等基準測試中表現優越,尤其在涉及多個對象組合、不同屬性和關係的密集提示方面表現出色。

需求人群:

"適用於需要改進文字對影象模型的長文字理解和提示跟隨能力的場景。"

使用場景示例:

社交媒體平臺希望改進其自動生成影象的提示對齊能力,使用ELLA進行最佳化。

研究人員需要對複雜文章進行影象生成,使用ELLA提高提示跟隨和理解能力。

設計師需要根據詳細描述生成影象,藉助ELLA實現文字到影象的精準轉換。

產品特色:

透過LLM增強擴散模型的文字對齊能力

無需訓練U-Net和LLM即可提高模型的提示跟隨能力

設計了時間感知語義連線器,提取LLM中的時間步相關條件

提供了Dense Prompt Graph Benchmark基準測試,評估文字對影象模型的密集提示跟隨能力

能夠與社區模型和下游工具(如LoRA和ControlNet)無縫整合,提高其文字-影象對齊能力