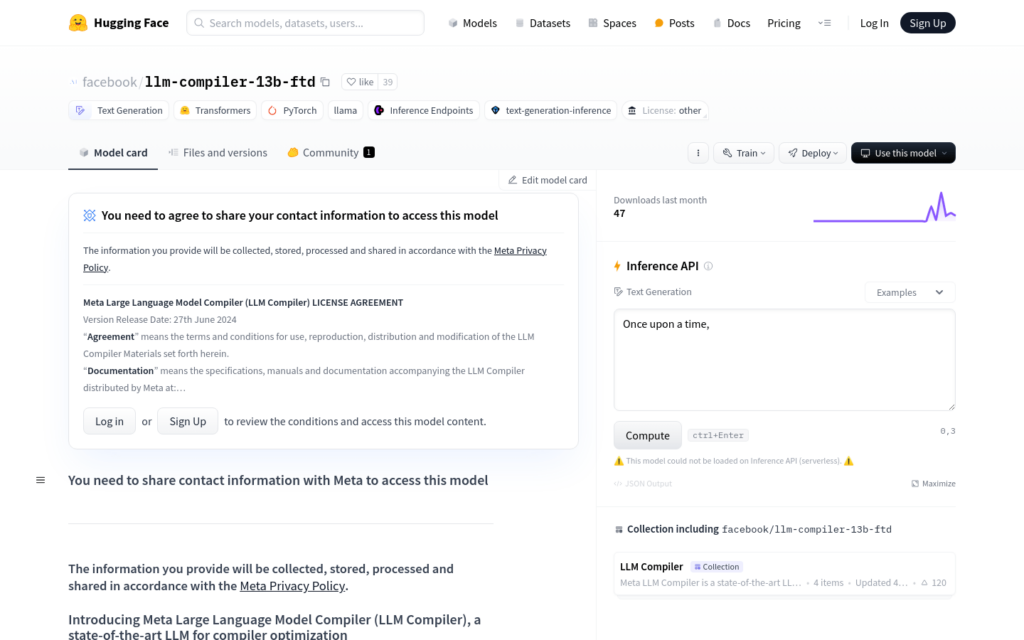

連結:https://huggingface.co/facebook/llm-compiler-13b-ftd

Meta Large Language Model Compiler (LLM Compiler-13b-ftd) 是一個基於Code Llama構建的先進大型語言模型,專注於編譯器最佳化和程式碼推理。它在預測LLVM最佳化效果和彙程式設計式碼反編譯方面展現出了卓越的效能,能夠顯著提高程式碼效率和減小程式碼體積。

需求人群:

- LLM Compiler主要面向編譯器研究人員和工程師,以及需要進行程式碼最佳化的開發者。它適合那些尋求透過深度學習技術提高程式碼效率和減小程式體積的專業使用者。

使用場景示例:

- 用於最佳化編譯器生成的中間表示(IR)的程式碼大小。

- 在開發新編譯器技術時,預測最優的最佳化傳遞序列。

- 將彙程式設計式碼反編譯為LLVM IR,以便於進一步的程式碼分析和最佳化。

產品特色:

- 預測LLVM最佳化對程式碼大小的影響

- 生成最小化程式碼大小的最佳化傳遞列表

- 從x86_64或ARM彙程式設計式碼生成LLVM IR

- 在編譯器最佳化任務中實作接近完美的輸出複製

- 提供7B和13B引數的模型以滿足不同服務和延遲需求

- 遵守Meta的許可證和可接受使用政策

使用教學:

安裝必要的庫,如transformers。

使用AutoTokenizer從預訓練模型中載入分詞器。

建立transformers.pipeline以設定文本生成的pipeline。

透過pipeline傳遞程式碼片段,並設定生成引數,如do_sample、top_k等。

獲取生成的序列,並評估生成的文本以確定其適用性。