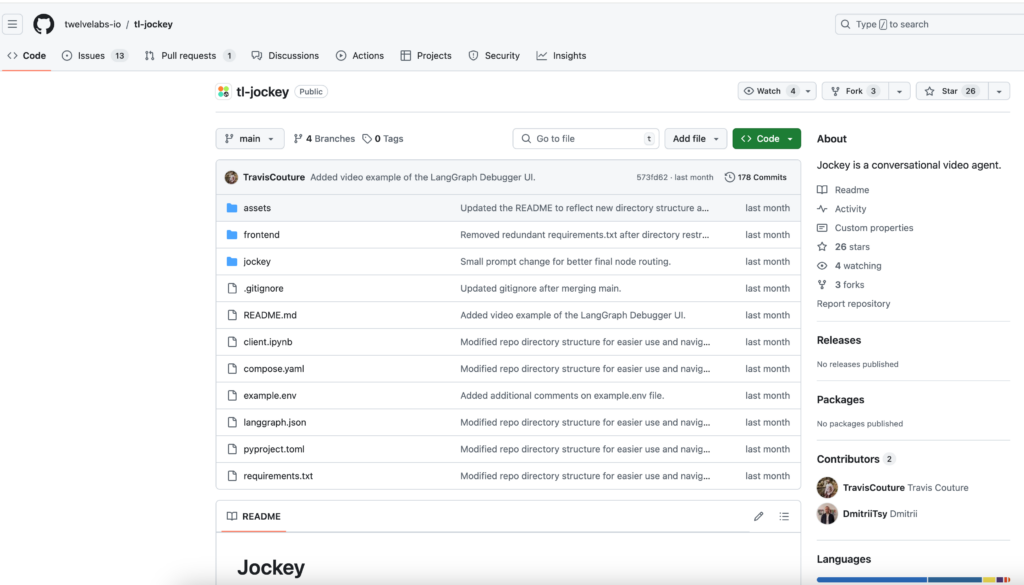

連結:https://github.com/twelvelabs-io/tl-jockey

Jockey是一個基於Twelve Labs API和LangGraph構建的對話式影片代理。它將現有的大型語言模型(Large Language Models, LLMs)的能力與Twelve Labs的API結合使用,透過LangGraph進行任務分配,將複雜影片工作流程的負載分配給適當的基礎模型。LLMs用於邏輯規劃執行步驟並與使用者互動,而與影片相關的任務則傳遞給由影片基礎模型(Video Foundation Models, VFMs)支援的Twelve Labs API,以原生方式處理影片,無需像預先生成的字幕這樣的仲介表示。

需求人群:

- Jockey主要面向需要處理複雜影片工作流程的開發者和團隊,尤其是那些希望利用大型語言模型來增強影片內容創作和編輯流程的使用者。它適合需要高度自訂和自動化影片處理任務的專業使用者。

使用場景示例:

- 影片編輯團隊使用Jockey自動化影片剪輯和字幕生成。

- 內容創作者利用Jockey生成影片草稿和故事板。

- 教育機構使用Jockey建立互動式影片教學。

產品特色:

- 結合大型語言模型與影片處理API進行復雜影片工作流程的負載分配。

- 使用LangGraph進行任務分配,提高影片處理效率。

- 透過LLMs邏輯規劃執行步驟,增強使用者互動體驗。

- 無需仲介表示,直接利用影片基礎模型處理影片任務。

- 支援自訂和擴充,以適應不同的影片相關用例。

- 提供終端和LangGraph API伺服器部署選項,靈活適應開發和測試需求。

使用教學:

1. 安裝必要的外部依賴,如FFMPEG、Docker和Docker Compose。

2. 克隆Jockey的GitHub倉庫到本地環境。

3. 建立並啟用Python虛擬環境,安裝所需的Python包。

4. 配置.env檔案,新增必要的API金鑰和環境變數。

5. 使用Docker Compose部署Jockey API伺服器。

6. 透過終端執行Jockey實例進行測試或使用LangGraph API伺服器進行端到端部署。

7. 使用LangGraph Debugger UI進行除錯和端到端測試。