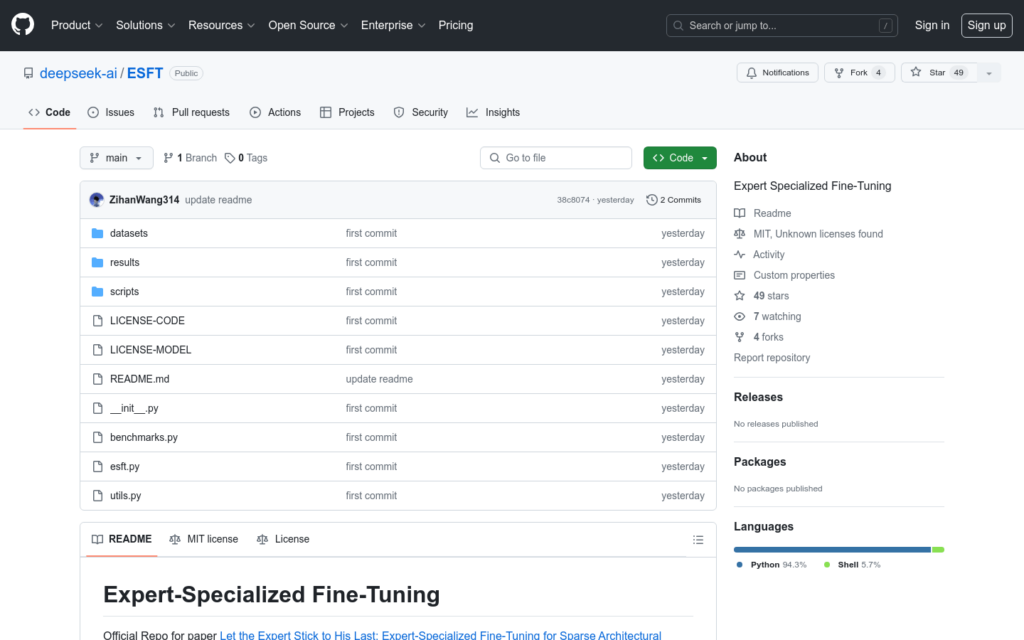

連結:https://github.com/deepseek-ai/ESFT

Expert Specialized Fine-Tuning (ESFT) 是一種針對具有專家混合(MoE)架構的大型語言模型(LLMs)的高效定製化微調方法。它透過僅調整與任務相關的部分來最佳化模型效能,提高效率,同時減少資源和儲存的使用。

需求人群:

- ESFT 適合需要對大型語言模型進行定製化微調的研究人員和開發者。它能夠幫助他們提高模型在特定任務上的效能,同時降低資源消耗。

使用場景示例:

- 研究人員使用 ESFT 微調模型以提高在自然語言處理任務上的表現。

- 開發者利用 ESFT 最佳化模型,以適應特定行業的語言處理需求。

- 教育機構採用 ESFT 來定製教學輔助模型,提高教學互動性。

產品特色:

- 安裝依賴並下載必要的適配器以快速啟動。

- 使用 eval.py 腳本來評估模型在不同資料集上的效能。

- 使用 get_expert_scores.py 腳本來計算每個專家基於評估資料集的分數。

- 使用 generate_expert_config.py 腳本來生成配置,以轉換僅基於任務相關任務訓練的 MoE 模型。

使用教學:

1. 克隆或下載 ESFT 專案到本地。

2. 進入 esft 目錄,安裝所需的依賴項。

3. 下載必要的適配器以適配不同的大型語言模型。

4. 使用 eval.py 腳本來評估模型在特定資料集上的效能。

5. 根據評估結果,使用 get_expert_scores.py 腳本來計算專家分數。

6. 使用 generate_expert_config.py 腳本來生成配置,最佳化模型結構。

7. 根據生成的配置調整模型,進行進一步的訓練和測試。