連結:https://huggingface.co/microsoft/Florence-2-base

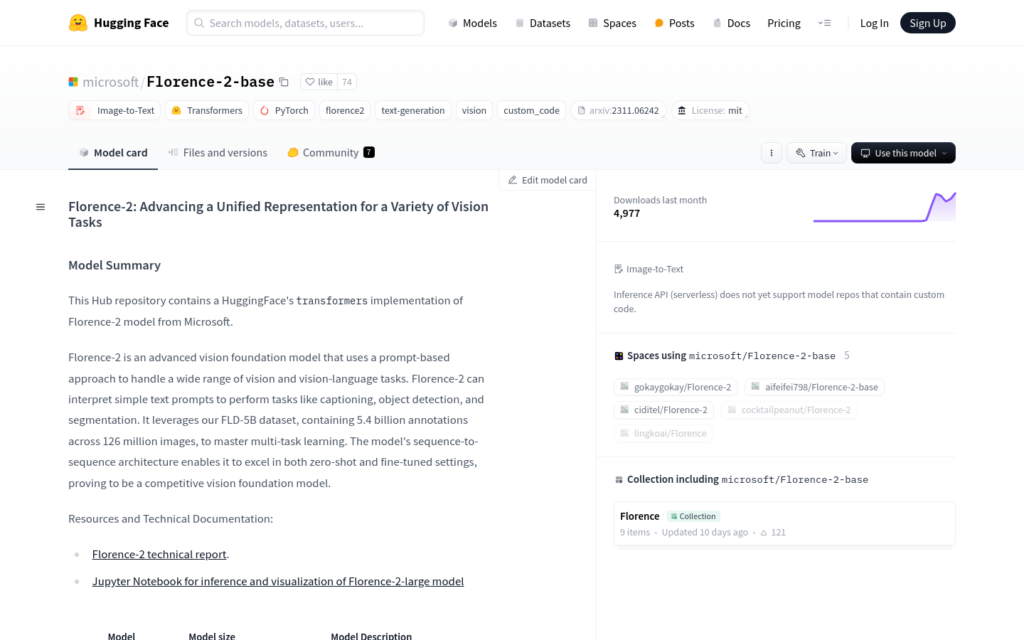

Florence-2是由微軟開發的高階視覺基礎模型,採用基於提示的方法處理廣泛的視覺和視覺-語言任務。該模型能夠解釋簡單的文本提示,執行如描述、目標偵測和分割等任務。它利用包含54億個註釋的5.4億張影象的FLD-5B資料集,精通多工學習。模型的序列到序列架構使其在零樣本和微調設定中都表現出色,證明其為有競爭力的視覺基礎模型。

需求人群:

“目標受眾為需要處理視覺和視覺-語言任務的研究人員和開發者,如影象描述、目標偵測和影象分割等。Florence-2的多工學習能力和序列到序列架構使其成為這些任務的理想選擇。”

使用場景示例:

使用Florence-2生成影象描述

利用Florence-2進行目標偵測

透過Florence-2實作影象分割

產品特色:

影象到文本轉換

基於提示的文本生成

視覺和視覺-語言任務處理

多工學習

零樣本和微調效能

序列到序列架構

使用教學:

1. 匯入必要的庫和模型:`AutoModelForCausalLM`和`AutoProcessor`。

2. 從Hugging Face載入預訓練模型和處理器。

3. 定義要執行的任務提示。

4. 載入或獲取待處理的影象。

5. 透過處理器將文本和影象轉換為模型可接受的輸入格式。

6. 使用模型生成輸出,如文本描述或目標偵測框。

7. 對生成的輸出進行後處理,以獲得最終結果。

8. 列印或以其他方式展示結果。