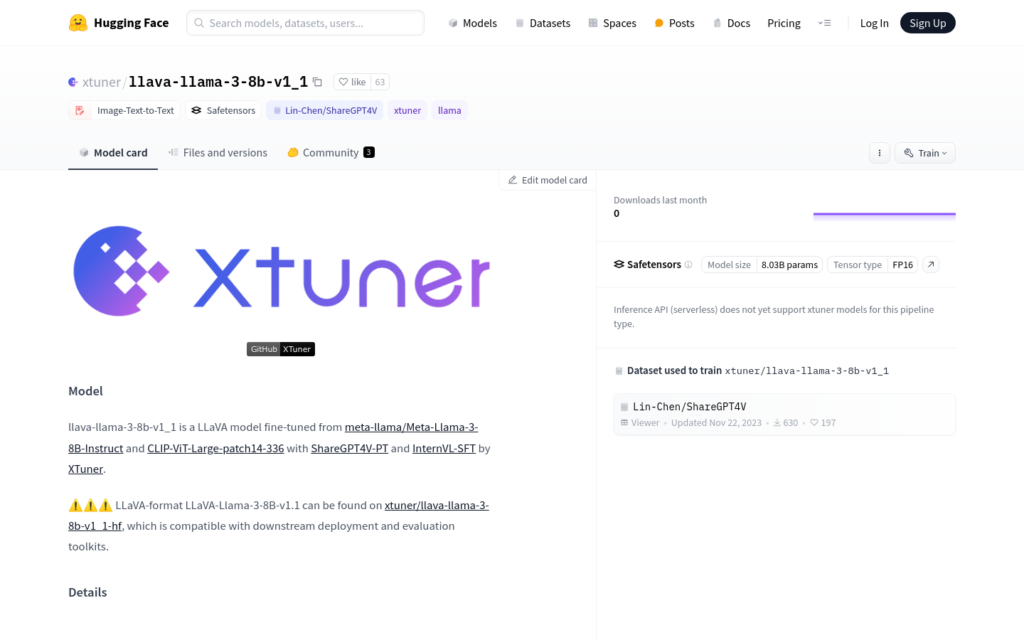

Link:llava-llama-3-8b-v1-1

llava-llama-3-8b-v1_1是一個由XTuner最佳化的LLaVA模型,它基於meta-llama/Meta-Llama-3-8B-Instruct和CLIP-ViT-Large-patch14-336,並透過ShareGPT4V-PT和InternVL-SFT進行了微調。該模型專為影象和文本的結合處理而設計,具有強大的多模態學習能力,適用於各種下游部署和評估工具包。

需求人群:

["資料科學家: 需要進行影象和文本結合的深度學習研究。","機器學習工程師: 構建和部署多模態學習模型以解決實際問題。","研究人員: 探索和實驗多模態人工智慧的潛力和應用。"]

使用場景示例:

用於影象標註和描述生成,提高影象搜尋的準確性。

在社交媒體分析中,結合影象和文本內容進行情感分析。

作為聊天機器人的後端,提供更豐富的使用者互動體驗。

產品特色:

多模態學習: 結合了文本和影象處理的能力,能夠理解和生成與影象相關的文本。

高效微調: 透過ShareGPT4V-PT和InternVL-SFT進行微調,提高了模型的適應性和準確性。

相容性強: 與多種下游部署和評估工具包相容,方便整合和使用。

大規模引數: 擁有8.03B的引數量,提供了強大的模型效能。

高精度結果: 在多個評估指標上取得了優異的成績,如72.3%和66.4%等。

支援FP16: 模型支援FP16精度,有助於在資源有限的設備上執行。